Während ihrer kompletten beruflichen Laufbahn stritten Bill Gates und Steve Jobs über zwei konkurrierende Philosophien für die digitale Welt: ob Hardware und Software eng integriert oder offen sein sollten. In seinem letzten Gespräch mit Steve Jobs machte der Microsoft-Gründer dann ein Eingeständnis: „Ich dachte immer, dass das offene horizontale Modell die Oberhand gewinnen würde, aber du hast bewiesen, dass auch das integrierte vertikale Modell großartig sein kann.“ Bei der Wiedergabe des Gesprächs machte Gates später eine Einschränkung und die könnte sich zu einer realitätsnahen Prophezeiung auswachsen:

„Der integrierte Ansatz funktionierte gut, solange Steve am Steuer war. Das heißt aber nicht, dass er auch in Zukunft noch viele Runden gewinnen wird.“

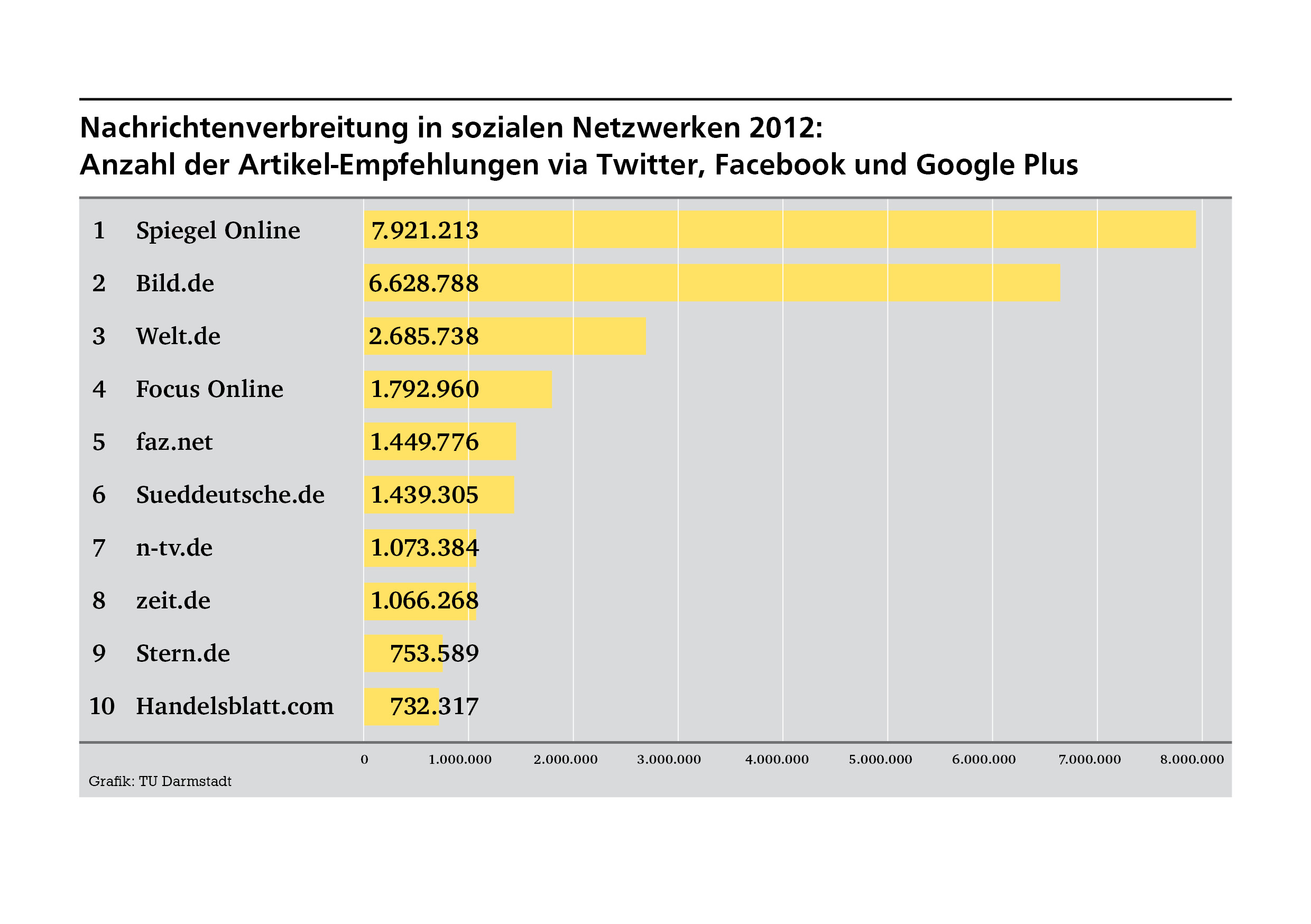

Wenn ein Apple-Fanboy wie der App-Entwickler und Mobile Business-Experte Ralf Rottmann das Lager wechselt und von der Innovationskraft des neuen Nexus 4 von Google schwärmt, sollten in Cupertino die Warnleuchten angehen. Sein Blogpost “An iPhone lover’s confession: I switched to the Nexus 4. Completely” hat international wie eine Bombe eingeschlagen und mit über 17.000 Likes, Retweets und Google Plus-Empfehlungen die exorbitanten Sascha Lobo-Werte in den Schatten gestellt. Sein privater Server brach schon eine halbe Stunde nach der Veröffentlichung zusammen. Bei den Hackernews landete er auf dem ersten Platz und selbst die Times zitierte den App-Guru. In der Vergangenheit hat Rottmann regelmäßig andere Plattformen getestet. Dazu zählen auch die Android-Telefone. Spätestens nach vier Tagen ist er wieder wehmütig zum iPhone zurückgekehrt:

„Und dann kam das Nexus 4. Auch hier hatte ich keine hohen Erwartungen. Statt das Gerät wieder bei eBay zu verticken, bin ich hängengeblieben. Eine Rückkehr zum iPhone 5 schließe ich aus“, so Rottmann im ichsagmal-Interview.

Beim Nexus 4 liege Google auf Augenhöhe mit Apple.

„Und das ist nicht alles. Hinzu kommen Innovationen, die Apple nicht vorweisen kann. Beispielsweise die Interaktion der Apps, die Anbindung der Applikationen an soziale Netzwerke, ohne einen Wechsel bei den Diensten vornehmen zu müssen. Hier wird eine Integrationstiefe erreicht, die iOS nicht ermöglicht. Apple beschränkt den Nutzer und zwingt ihn, um die Ecke zu denken“, kritisiert Rottmann.

Es liege vielleicht an der DNA von Google und der Mashup-Tradition des Suchmaschinen-Giganten. Das Zusammenführen unterschiedlicher Dienste und Kontexte zu etwas Besseren sei die Stärke von Google.

„Unter Android kann man Fotos oder Screenshots ganz einfach in die Dropbox schieben und dann an einem anderen Gerät wieder herausholen. Mit dem iPhone oder iPad geht das nicht, da der Foto-Ordner keine Verbindung zur Dropbox aufnehmen kann. Einzelne Fotos oder Screenshots muss ich deshalb immer per E-Mail schicken, damit ich sie auf meinem Mac-Rechner dann weiterverwenden kann. Auch bei der Geräte-Synchronisation hängt Apple hinterher: Bei Android laufen die Synchronisationsvorgänge praktisch unmerklich im Hintergrund, während das iPhone immer noch regelmäßig an den Mac angebunden werden will“, bestätigt bwlzweinull-Blogger Matthias Schwenk.

„Apple muss den Abstand zwischen den Gitterstäben stark erweitern. Am Besten soweit, dass der Nutzer sich nicht im Käfig wähnt und nur soweit, dass die gewohnte Sicherheit bei Apple noch gewährleistet ist“, fordert der Social Media-Berater und Blogger Camp-Mitorganisator Hannes Schleeh.

Soweit ein kleiner Ausblick auf meine morgige The European-Kolumne. Bin auf Eure Reaktion gespannt.

Reaktionen der Börse sind ja schon zu verzeichnen. Jedenfalls steht die Apple-Aktie unter Druck. Und das liegt vor allem an der schwachen iPhone 5-Nachfrage, wie das Wall Street Journal berichtet:

„Apple hat seine Bestellungen für Bauteile des iPhone 5 wegen einer unerwartet schwachen Nachfrage zurückgefahren. Das berichten Personen, die mit der Angelegenheit vertraut sind. Die Aufträge für Displays für das neue iPhone etwa seien für das erste Quartal auf rund die Hälfte der Menge gesunken, die das Unternehmen ursprünglich anvisiert hatte. Auch für andere Komponenten habe Apple die Auftragsmengen verringert und die Zulieferer vergangenen Monat darüber informiert, heißt es. Die japanische Wirtschaftszeitung Nikkei hatte am Montag als erste darüber berichtet. Apple-Vertreter waren zunächst nicht für eine Stellungnahme erreichbar.“

Ralf Rottmann hofft auf einen deutlichen Kurswechsel beim iOS 7. Seine Wünsche und Anregungen wird er in seinem Blog noch niederlegen. Auch darauf bin ich gespannt.

Im Netz können Sterne schnell verglühen – das bekommt derzeitig Apple zu spüren. Wie AGB-Diktatoren von Nutzern abgestraft werden, beleuchtet sehr schön t3n. Instagram verliert 50 Prozent seiner aktiven Nutzer in einem Monat.