Arbeitgeber optimieren ihre Karriereseiten noch immer für Google. Bewerbende fragen längst ChatGPT, Gemini und Perplexity. Wer dort nicht erscheint, verliert Fachkräfte, bevor der erste Klick entsteht.

Recruiting war lange ein Geschäft mit Sichtbarkeit. Google-Ranking, Stellenbörsen, Social-Media-Reichweite, Klickzahlen, Traffic auf der Karriereseite, Conversion Rate im Bewerbungsformular: So ließ sich eine Welt vermessen, in der Menschen eine Suchanfrage stellten, eine Trefferliste erhielten, Links prüften und sich dann durch die digitale Infrastruktur eines Arbeitgebers bewegten. Die Karriereseite war der Bahnhof, Google die Hauptstrecke, Social Media das Schaufenster, die Stellenanzeige der Fahrplan.

Diese Welt verschwindet nicht über Nacht. Aber sie verliert ihre Deutungshoheit. Wolfgang Brickwedde, Leiter des Institute for Competitive Recruiting, hat in der Zukunft Personal Digital Experience eine Verschiebung beschrieben, die viele Personalabteilungen noch unterschätzen: Bewerbende suchen nicht mehr bloß. Sie lassen sich Antworten erzeugen. Sie fragen KI-Systeme nach passenden Arbeitgebern, lassen Lebensläufe umformulieren, Anschreiben erstellen, Stellenanzeigen vergleichen, Bewerbungslinks zusammentragen und Arbeitgeber nach Kultur, Bezahlung, Benefits oder Standortfiltern sortieren.

Das verändert die Logik des Recruiting grundlegend. Google zeigte Links. ChatGPT, Gemini oder Perplexity formulieren Empfehlungen. Aus Suchmaschinenoptimierung wird Antwortfähigkeit. Aus Reichweite wird Zitierfähigkeit. Aus Traffic wird Erwähnung. Aus der Frage „Wie viele Menschen waren auf unserer Karriereseite?“ wird die sehr viel heiklere Frage: „Kommen wir in den Antworten der KI überhaupt vor?“

Die alte KPI-Welt zählt, was leicht zu zählen ist

Brickwedde begann seinen Vortrag mit einem Befund, der vielen Recruiting-Organisationen vertraut vorkommen dürfte. Gemessen wird vor allem, was technisch bequem verfügbar ist: Zahl der Bewerbungen, Bewerbungen pro Stelle, Time to Hire, Visits auf der Karriereseite, Herkunft der Bewerber, Erfolg von Social-Media-Aktivitäten. Für wichtig halten viele Unternehmen aber andere Größen: Qualität der Bewerber, Zufriedenheit der neu Eingestellten, Candidate Experience, Frühfluktuation, Zufriedenheit der Fachabteilungen.

Damit entsteht eine methodische Schieflage. Die quantitativen Größen dominieren die Dashboards, die qualitativen Größen entscheiden über den Erfolg. Wer viele Klicks misst, weiß noch nicht, ob die richtigen Personen gekommen sind. Wer Karriereseiten-Traffic feiert, weiß noch nicht, ob die Arbeitgebermarke in den relevanten KI-Antworten auftaucht. Wer Social-Media-Reichweite ausweist, übersieht womöglich, dass jüngere Zielgruppen ihre Jobsuche gerade auf neue Werkzeuge verlagern.

Das Problem ist nicht die Messung an sich. Das Problem ist ihr Gegenstand. Recruiting misst zu oft die Bewegungen in einer alten Sucharchitektur. Die neue Architektur beginnt mit einem Dialog.

ChatGPT baut keine Trefferliste, es baut eine Reise

Brickwedde zeigte eine Candidate Journey, die klassische Recruiting-Kennzahlen alt aussehen lässt. Ein Kandidat findet eine Stelle, lässt sich den Lebenslauf passend zuschneiden, erhält ein Anschreiben, bekommt weitere Stellen in seinem Postleitzahlengebiet vorgeschlagen und kann sich Bewerbungslinks ausgeben lassen. Die KI agiert dabei wie ein persönlicher Karrierecoach, Rechercheassistent und Bewerbungssekretär in einem.

Früher hätte ein Bewerber mehrere Stationen durchlaufen: Google-Suche, Stellenbörse, Karriereseite, Social-Media-Profil, Kununu, Bewerbungsformular. Heute kann ein KI-Agent diese Stationen selbst ansteuern, Informationen extrahieren, sortieren und in eine Entscheidungsvorlage überführen. Der Mensch sieht am Ende nicht mehr jede Quelle, jeden Link und jede Zwischenstation. Er sieht eine Empfehlung.

Für Arbeitgeber ist das unbequem. In der alten Welt konnte man mit Sichtbarkeit noch viel retten. In der neuen Welt muss man in den Quellen vorkommen, aus denen die KI ihre Antwort baut. Die Karriereseite bleibt wichtig, doch sie ist nur eine Quelle neben anderen: Fachmedien, Rankings, LinkedIn-Artikel, Arbeitgeberbewertungen, Unternehmensseiten, Presseberichte, YouTube, Wikipedia, branchenspezifische Plattformen, Blogs, Studien und Foren. Entscheidend ist, welche Quellen für die konkrete Zielgruppe und die konkrete Frage als vertrauenswürdig gelten.

Zehn Prozent Überschneidung reichen nicht für Sicherheit

Eine Zahl aus Brickweddes Vortrag sollte Personalabteilungen aufwecken: Zwischen Google-Suche und ChatGPT-Antworten gebe es bei bestimmten Arbeitgeberabfragen nur rund zehn Prozent Überschneidung. Wer bei Google sichtbar ist, kann in ChatGPT unsichtbar bleiben. Wer in der klassischen Trefferliste gut liegt, kann in der KI-Antwort fehlen. Wer seine Arbeitgebermarke über Jahre auf SEO ausgerichtet hat, besitzt damit eine gute Grundlage, aber keine Garantie.

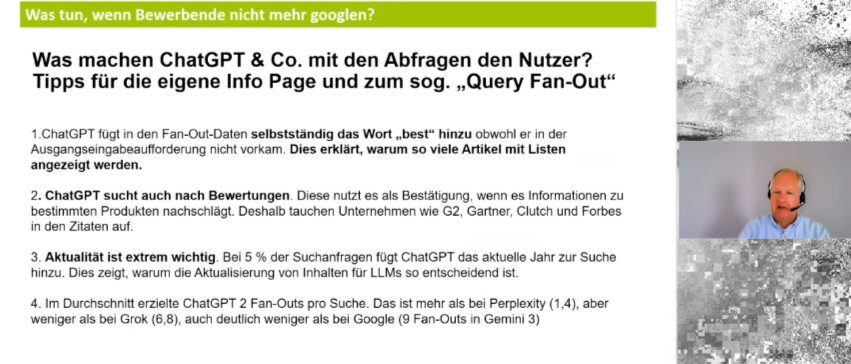

Der Grund liegt in der Arbeitsweise der Systeme. KI-Modelle greifen auf Trainingsdaten, Websuche, vertrauenswürdige Quellen und strukturierte Inhalte zurück. Sie zerlegen Suchanfragen in Unterfragen, erweitern sie, fügen Begriffe wie „beste“, „Top“, „Liste“, „Vergleich“ oder „Ranking“ hinzu und ziehen daraus Antwortbausteine. Brickwedde nannte das Query-Fanout. Die eingegebene Frage wird aufgefächert. Wer als Arbeitgeber nur auf der eigenen Karriereseite behauptet, attraktiv zu sein, liefert damit noch keinen Stoff für eine belastbare Antwort.

Die KI sucht nach Vergleichbarkeit. Sie liebt Listen, Best-of-Formate, Top-Arbeitgeber-Übersichten, strukturierte Abschnitte, FAQ-Formate, klare Überschriften, aktuelle Daten und eindeutige Aussagen. Wer etwa für Elektrotechniker in Hamburg sichtbar werden will, sollte nicht bloß eine Stellenanzeige veröffentlichen. Er sollte beantworten, weshalb das Unternehmen für Elektrotechniker relevant ist, welche Projekte warten, welche Technologien genutzt werden, welche Gehaltsspannen realistisch sind, welche Weiterbildung möglich ist, welche Standorte passen, welche Benefits glaubwürdig sind und wie das Unternehmen im regionalen Wettbewerbsfeld steht.

Die Karriereseite wird zur Datenquelle

Viele Arbeitgeber behandeln ihre Karriereseite noch immer wie eine Imagebroschüre mit Bewerbungsbutton. Das reicht nicht mehr. Für KI-Systeme muss eine Karriereseite lesbar, strukturierbar und zitierfähig sein. Sie braucht präzise Rollenbeschreibungen, klare Jobfamilien, Standortinformationen, Benefits in nachvollziehbarer Form, Gehaltslogik, Weiterbildungswege, Führungskultur, Teamgeschichten, technische Rahmenbedingungen, Bewerbungsablauf, Reaktionszeiten und authentische Einblicke.

Entscheidend ist dabei die Form. Lange Marketingtexte mit austauschbaren Aussagen helfen wenig. „Wir bieten spannende Aufgaben in einem dynamischen Team“ ist für Menschen leer und für KI armselig. Besser sind konkrete Antworten auf konkrete Fragen: Welche Aufgaben übernimmt ein Mechatroniker in diesem Unternehmen? Welche Schichtmodelle gibt es? Wie lange dauert der Bewerbungsprozess? Gibt es eine Rückmeldung nach einem Werktag, nach einer Woche oder erst nach mehreren Wochen? Welche KI-Werkzeuge kommen im Alltag zum Einsatz? Welche Weiterbildung wird bezahlt? Wie viel Reisezeit ist realistisch? Welche Karrierepfade gibt es für Fachkräfte ohne Hochschulabschluss?

Je präziser ein Arbeitgeber solche Fragen beantwortet, desto höher die Chance, in KI-Antworten aufzutauchen. Die Karriereseite wird damit weniger Schaufenster, mehr Wissensbasis. Sie muss so gebaut sein, dass Menschen sie verstehen und Maschinen sie verarbeiten können.

Corporate Blogs sind wieder relevant

In der Diskussion kam die Frage auf, welche Rolle Corporate Blogs in dieser neuen Suchwelt spielen. Brickweddes Antwort lässt sich klar übersetzen: Sie können sehr relevant sein, falls sie fachlich belastbar, gut strukturiert und von KI-Systemen auffindbar sind. Ein Corporate Blog, der lediglich Kampagnenmotive verlängert, bleibt schwach. Ein Blog, der Fragen beantwortet, Vergleiche ermöglicht, Expertenwissen zeigt, aktuelle Begriffe sauber erklärt und branchenspezifische Orientierung liefert, kann zur wichtigen Quelle werden.

Gerade im Recruiting wird das unterschätzt. Viele Arbeitgeber veröffentlichen emotionale Kulturgeschichten, aber keine hilfreichen Entscheidungstexte. Bewerbende fragen KI-Systeme nicht nach Werbeslogans. Sie fragen nach passenden Arbeitgebern für Softwareentwickler in Köln, nach familienfreundlichen Kliniken in Nordrhein-Westfalen, nach Unternehmen mit guter Ausbildung in der Energiewirtschaft, nach Arbeitgebern mit echter Weiterbildung für Quereinsteiger, nach Betrieben, in denen Schichtarbeit planbar ist.

Ein Corporate Blog kann solche Fragen bedienen. Er kann Rankings einordnen, Berufsbilder erklären, Technologien beschreiben, Mitarbeiterinterviews mit harten Informationen verbinden, regionale Arbeitsmärkte analysieren und Vergleichskriterien offenlegen. Damit steigt die Chance, in Antworten verwertet zu werden.

Noch wirksamer können Corporate Influencer sein. Nicht, weil persönliche Posts magisch wären. Der Grund ist einfacher: Personen gelten in professionellen Netzwerken oft als glaubwürdigere Quelle als anonyme Unternehmenskommunikation. LinkedIn spielt dabei eine besondere Rolle. Brickwedde wies darauf hin, dass klassische Posts zwar wirken können, LinkedIn-Artikel aber häufig länger verfügbar, besser aktualisierbar und für KI-Systeme nützlicher sind. Wer also Fachkräfte erreichen will, sollte nicht nur kurze Posts absetzen, die nach zwei Tagen im Strom verschwinden. Er sollte argumentative Artikel veröffentlichen, die Begriffe besetzen, Fragen beantworten und Expertise zeigen.

GEO ersetzt SEO nicht, es erweitert es

Der neue Begriff heißt GEO: Generative Engine Optimization. Gemeint ist die Optimierung für generative Antwortsysteme. SEO bleibt dabei nicht wertlos. Saubere technische Struktur, Crawlbarkeit, Backlinks, verständliche Seitenarchitektur und relevante Inhalte bleiben Grundvoraussetzungen. GEO verschiebt aber die Perspektive. Es geht nicht mehr allein darum, oben in einer Trefferliste zu stehen. Es geht darum, in einer Antwort erwähnt, zitiert, empfohlen oder als relevante Quelle verarbeitet zu werden.

Das verändert auch die Metriken. Rankings verlieren an Aussagekraft, weil KI-Antworten nicht stabil sind. Dieselbe Anfrage kann zehn Minuten später andere Arbeitgeber nennen. Wichtiger wird daher der Anteil der Erwähnungen. Wie oft erscheint die Arbeitgebermarke in relevanten Prompts? In welchem Kontext? Mit welcher Tonalität? Welche Wettbewerber tauchen häufiger auf? Welche Quellen werden zitiert? Welche Botschaften werden mit dem Unternehmen verbunden? In welchen Modellen ist die Sichtbarkeit besser: ChatGPT, Gemini, Perplexity, Claude?

Aus SEO-Ranking wird Share of Voice in KI-Antworten. Aus Position wird Zitieranteil. Aus Klick wird Antwortpräsenz.

Die neue KPI-Frage lautet: Werden wir empfohlen?

Für Recruiting-Verantwortliche bedeutet das einen Kulturwechsel. Sie müssen ihre KPI-Landschaft erweitern. Karriereseiten-Traffic bleibt wichtig, aber er bildet nur noch einen Teil der Realität ab. Social-Media-Reichweite bleibt nützlich, aber sie verliert an Erklärungskraft, sobald Bewerbende Informationen über KI-Systeme verdichten lassen. Bewerbungszahlen bleiben relevant, doch sie zeigen erst das Ende eines vorgelagerten Auswahlprozesses.

Die neue Frage lautet: Taucht die Arbeitgebermarke im Relevant Set der KI auf? Wird sie bei den gesuchten Berufsgruppen erwähnt? Wird sie positiv, neutral oder negativ beschrieben? Werden eigene Karriereseiten, Corporate Blogs, LinkedIn-Artikel oder Fachbeiträge als Quellen genutzt? Welche Prompts führen zu Wettbewerbern, welche zum eigenen Unternehmen? Welche Lücken entstehen bei Standorten, Berufsbildern, Benefits, Gehalt, Kultur und Entwicklungschancen?

Das ist nicht bloß ein technisches Thema für Spezialisten. Es gehört in die Steuerung des Recruiting. Wer für bestimmte Zielgruppen unsichtbar ist, kann seine Personalplanung nicht mit Reichweitenzahlen aus der alten Welt beruhigen.

Bewerbende wechseln das Werkzeug, Arbeitgeber bleiben im alten Reporting

Besonders folgenreich ist die Entwicklung für schwer zu besetzende Profile. Pflegekräfte, Mechatroniker, Ingenieure, IT-Fachkräfte, Facharbeiter in Energie und Infrastruktur, Auszubildende in Engpassberufen: Sie alle haben wenig Zeit und viele Optionen. Je stärker KI-Systeme die Vorauswahl vereinfachen, desto wichtiger wird die frühe Antwortpräsenz. Wer dort fehlt, kommt gar nicht mehr in die Auswahl.

Die alte Arbeitgeberreaktion lautete häufig: mehr Budget auf Stellenbörsen, mehr Social Media, mehr Performance-Marketing. Das kann weiterhin helfen. Doch es löst das Grundproblem nicht, falls die Informationen unstrukturiert, austauschbar oder für KI-Systeme schwer verwertbar sind. Ein Arbeitgeber kann viel Geld in Reichweite stecken und trotzdem in der Antwortwelt fehlen.

Brickweddes Vortrag enthielt daher eine leise Zumutung an die Recruiting-Praxis: Viele Teams müssen nicht zuerst mehr posten. Sie müssen besser beschreiben. Sie müssen ihre Daten ordnen. Sie müssen ihre Arbeitgeberversprechen überprüfbar machen. Sie müssen Fachbereiche einbinden, um Rollen konkret zu erklären. Sie müssen Inhalte so bauen, dass ein Bewerber, ein KI-System und eine Führungskraft dieselbe Frage beantworten können: Weshalb ist dieser Arbeitgeber für diese Person in dieser Situation relevant?

Die gute Nachricht: Auch kleinere Arbeitgeber können sichtbar werden

Die neue Suchwelt bevorzugt nicht automatisch die größten Marken. Gewiss, bekannte Unternehmen haben Vorteile, weil sie häufiger erwähnt werden und über mehr Quellen verfügen. Doch KI-Systeme reagieren auch auf klar strukturierte, aktuelle, zitierwürdige Inhalte. Brickwedde zeigte Beispiele, in denen neu gesetzte Begriffe und LinkedIn-Artikel binnen kurzer Zeit in KI-Antworten auftauchten. Daraus folgt: Auch kleinere Arbeitgeber können Nischen besetzen.

Für den Mittelstand kann das ein Vorteil werden. Viele kleinere Unternehmen haben konkrete Geschichten, gute Arbeitsbedingungen, regionale Bindung, kurze Wege, sichtbare Projekte und echte Verantwortung. Sie verlieren im klassischen Arbeitgeberranking oft gegen bekannte Konzerne. In der KI-Suche können sie bei präzisen Fragen punkten: beste Ausbildungsbetriebe für Mechatronik in einer Region, Arbeitgeber mit planbarer Schichtarbeit, Unternehmen für Elektrotechnik mit Energiewende-Projekten, familienfreundliche Pflegeanbieter, IT-Arbeitgeber mit Weiterbildung für Quereinsteiger. Dazu müssen sie ihre Wirklichkeit besser dokumentieren. Nicht lauter, präziser.

Aus Recruiting wird Antwortarchitektur

Die kommenden Monate werden für Personalabteilungen eine Lernphase. Wer jetzt beginnt, relevante Prompts zu sammeln, Personas zu entwickeln, KI-Antworten zu monitoren, Karriereseiten zu strukturieren, LinkedIn-Artikel aufzubauen und Corporate Blogs als Wissensquellen zu begreifen, verschafft sich einen Vorsprung. Wer wartet, wird später in dichter besetzten Antwortfeldern kämpfen.

Der erste Schritt ist einfach. Recruiting-Verantwortliche sollten selbst in ChatGPT, Gemini und Perplexity eingeben, was Bewerbende fragen könnten: „Beste Arbeitgeber für Elektrotechniker in Hamburg“, „gute Arbeitgeber für Pflegekräfte mit planbaren Diensten in Köln“, „Unternehmen für Quereinsteiger im Vertrieb in NRW“, „Arbeitgeber mit Weiterbildung für Mechatroniker und guter Bezahlung“. Dann sollten sie prüfen, ob der eigene Name erscheint, welche Wettbewerber genannt werden, welche Quellen zitiert werden und welche Begründungen auftauchen.

Der zweite Schritt ist anspruchsvoller. Die eigene Karriereseite muss aus Sicht dieser Fragen neu gelesen werden. Gibt es eine Antwort? Ist sie konkret? Ist sie aktuell? Ist sie maschinenlesbar? Hat sie klare Überschriften? Gibt es Vergleichskriterien? Gibt es Belege? Gibt es Fachartikel, Interviews, Listen, FAQ-Seiten, Standortseiten, Berufsbilder und nachvollziehbare Bewerbungsprozesse?

Der dritte Schritt betrifft die Organisation. GEO im Recruiting ist keine Nebenaufgabe für die Social-Media-Redaktion. Es verbindet Employer Branding, Recruiting Analytics, HR-IT, Fachbereiche, Unternehmenskommunikation, Corporate Influencer und Datenstrategie. Genau darin liegt seine Sprengkraft.

Die Jobsuche der Zukunft beginnt nicht mehr zwingend mit einem Klick. Sie beginnt mit einer Frage. Arbeitgeber, die darauf keine verwertbare Antwort liefern, werden nicht abgelehnt. Sie werden gar nicht erst genannt.