Innovationen entstehen nach Ansicht des Bloggers Martin Bartonitz vor allem durch Regelbrechung. Man muss in der Lage sein, Altvertrautes nicht mehr in den gewohnten Bahnen zu betrachten: Anders denken und nicht mehr einfach weitermachen, weil man es ja immer schon so gemacht hat. Nicht wegsehen, sondern hinterfragen. In seinem jüngsten Beitrag beruft sich Bartonitz auf einen Vortrag von Gary Hamel („Reinventing the Technology of Human Accomplishment“).

Kein Manager sei mehr in der Lage alles zu wissen, was die einzelnen Experten seines Teams sich an Können angeeignet haben, so Hamel. Damit wandelt sich die Rolle des Managers. Hamel fordert einen Paradigmenwechsel im Management, weg von der Schaffung menschlicher Automaten. „Wer den Menschen nur als Automaten betrachtet, verpasst, dass dieser ein in höchstem Maße adaptives Wesen ist, ganz im Gegenteil zu einem hierarchisch organisierten Unternehmen“, schreibt Bartonitz und zitiert den ehemaligen Controller Niels Pfläging:

“Die Zwangsjacke, die sich Unternehmen durch exakte Pläne anziehen, wird immer enger. Doch alle Unternehmen können sich aus ihr befreien.”

Aber wie und mit welchem Personal?

Gefragt sind heute Selbstorganisation statt Hierarchie, Möglichkeitsräume statt pseudoexakter Planungen, Fehlerfreundlichkeit statt Standardisierung. Kein Befehl und Gehorsam, sondern Abschaffung der Ziegelstein-Diktatur in den Organisationen von Wirtschaft und Staat. Und was für ein Nachwuchspersonal kommt von den Universitäten im Geiste von Bologna? Akademische Automaten.

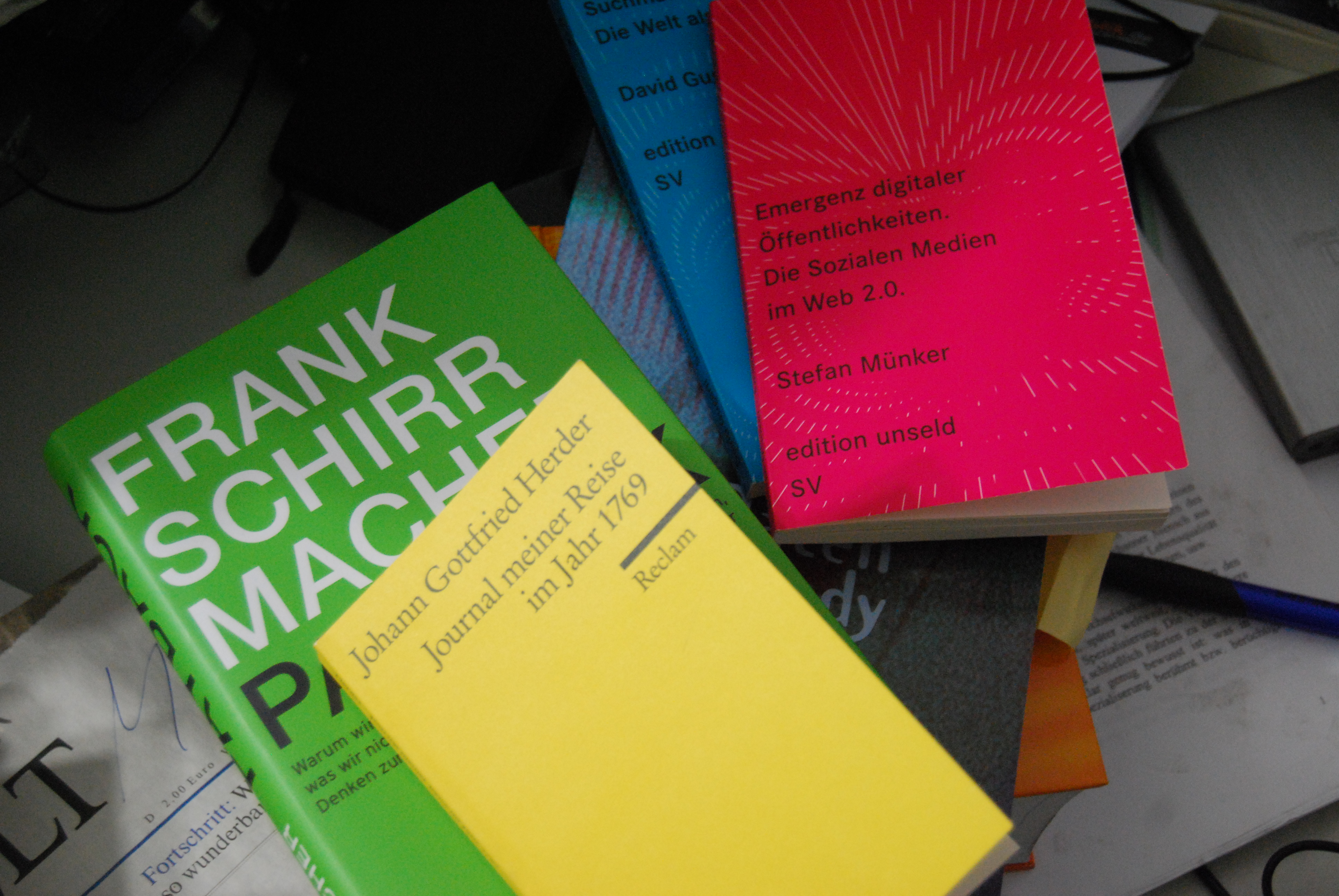

„Die heutige Universität ist keine ‚universitas‘ mehr, sondern eine Summe von Fachhochschulen“, kritisiert der Medienphilosoph Norbert Bolz in dem von ihm herausgegebenen Sammelband „Wer hat Angst vor der Philosophie?“ (erschienen im Wilhelm Fink Verlag).

Das verwaltete Studium finde eifrige Verfechter mittlerweile auch bei den Studenten, um deren „Zurichtung“ es den Bildungsplanern geht. Die Angst um den Job rufe nach handfestem, abfragbarem Wissen. Unreglementiertes Denken passt nicht in die Doktrin des Bologna-Prozesses. Es lässt sich nicht in das Schema von Ranglisten, Test und Training pressen. Antik war die Muße, modern ist die Verbeamtung des Denkens. Die Universitätslehre vermittelte Sinn, der Bologna-Prozess ruft nach einer operationalen Praxis.

Dekanate mutieren zum Service-Center. Lehre und Forschung werden durch Module und Projekte ersetzt. Den Professoren und Studenten wird heute das Apportieren beigebracht.

„Wer sind die Gewinner des Bologna-Prozesses? Zu den Gewinnern gehören die Verwaltung, deren Bedeutung ins Groteske angewachsen ist, und die Wissenschaftsfunktionäre in den Gremien“, bemerkt Bolz.

Gewinner seien aber auch die Professoren, die lieber Lehrer sein möchten, und die Studenten, die lieber Schüler bleiben wollen. Es ist der Verrat an der akademischen Freiheit des Denkens. In den Wissenschaftsfabriken mit ihren Sprachcodes und Trainingscamps wird nicht der Regelbruch kultiviert, sondern die Stoff-Bulimie: Reinschaufeln, auskotzen, vergessen. Wissenschaft funktioniert wie ein Jahrmarktsverkäufer:

„Hier noch eine Leberwurst und eine Salami – einen Büchsenöffner gibt es noch kostenlos dazu. Ein bisschen Jura, Mathe und Rechnungswesen. Regeln, Regeln, Regeln und das ist es dann“, kritisiert Professor Michael Zerr, Präsident der Karlshochschule.

Studenten sollten lernen, Dinge in Frage zu stellen, beispielsweise über den Sinn des Controllings.

„In erster Linie handelt es sich um eine Inszenierung von Rationalität. Unsere Studenten beschäftigen sich damit, wie man eine kalkulatorische Wirklichkeit inszeniert, welche Rituale sich im Management abspielen, welche Metaphern verwendet werden, um in einer Organisation Mikropolitik zu machen. Das ist das Programm unserer Universität“, sagt Zerr.

Es wäre nach Ansicht des IT-Personalexperten Udo Nadolski schon ein großer Fortschritt, wenn sich Manager, Politiker und Wissenschaftler von ihrer Rationalitätsgläubigkeit verabschieden und stärker mit dem Unerwarteten kalkulieren würden.

„Den von Joseph A. Schumpeter geprägten Begriff der kreativen Zerstörung muss man in seinen Konsequenzen auch zu Ende denken. Wer gesellschaftliche und wirtschaftliche Phänomene nur in Aggregatzuständen wahrnimmt und berechnet, vernachlässigt die Wirkungen von Innovationsrevolutionen. Technologien und Geschäftsmethoden können über Nacht wertlos werden. Etablierte Branchen gehen unter und neue entstehen“, erläutert Nadolski, Geschäftsführer von Harvey Nash.

Überall dort, wo Talent, Technik und Toleranz aufeinandertreffen, könnten richtige disruptive Innovationen oder Sprunginnovationen entstehen, meint der Zukunftsforscher Dr. Karlheinz Steinmüller.

Was notwendig sei, um ein günstiges Klima für Störer und Innovatoren zu schaffen, sei eine Kultur des Karnevals, Narrentums und des Scheiterns. Das gelte für Wirtschaft, Politik, Wissenschaft, Management und Medien. Mit dem Bologna-Prozess erzeugen wir das Gegenteil. Da sind wir schon mitten in der Thematik der zweiten Session des Blogger Camps am Mittwoch von 19,30 bis 20,00 Uhr: Von der zerstörerischen Kraft der digitalen Dauerdisruption. Teilnehmer: Katja Andes (Ideacamp UG), Lars Mensel (The European-Debattenmagazin), Dirk Elsner (blicklog), Andreas Klug (Ityx), Hannes Schleeh und Heinrich Rudolf Bruns. Moderation: Meine Wenigkeit.

Regelbrecher statt akademische Automaten wird auch das Thema meiner Mittwochskolumne für das Debattenmagazin „The European“ sein. Statements bis morgen (spätestens bis 14 Uhr) wieder hoch willkommen.