Es ist schon kurios: Da sitzen wir in einem Zeitalter, das sich rühmt, Maschinen zu bauen, die besser rechnen, besser sehen, besser entscheiden können als wir – und doch scheint die Künstliche Intelligenz (KI) am Prüfstein des Menschlichen immer wieder zu scheitern. Vielleicht liegt der Fehler gar nicht in der Technik, sondern in unserer Vorstellung von Perfektion. Was, wenn die wahre Genialität der KI nicht in ihrer Vollkommenheit liegt, sondern in ihrer Unvollständigkeit?

„Unvollendetes ist oft das Spannendste,“ so Professor Frank H. Witt in seiner Session auf der Next Economy Open #NEO24, die mir in seiner prägnanten Analyse nicht mehr aus dem Kopf gehen will. Witt schlug vor, KI weniger als Werkzeug, sondern als Spiegel zu begreifen: ein System, das uns zeigt, wo wir selbst nicht weiter wissen. Ein Gedanke, der zunächst irritiert, dann aber verlockend klar wird.

Der Charme der Paradoxien

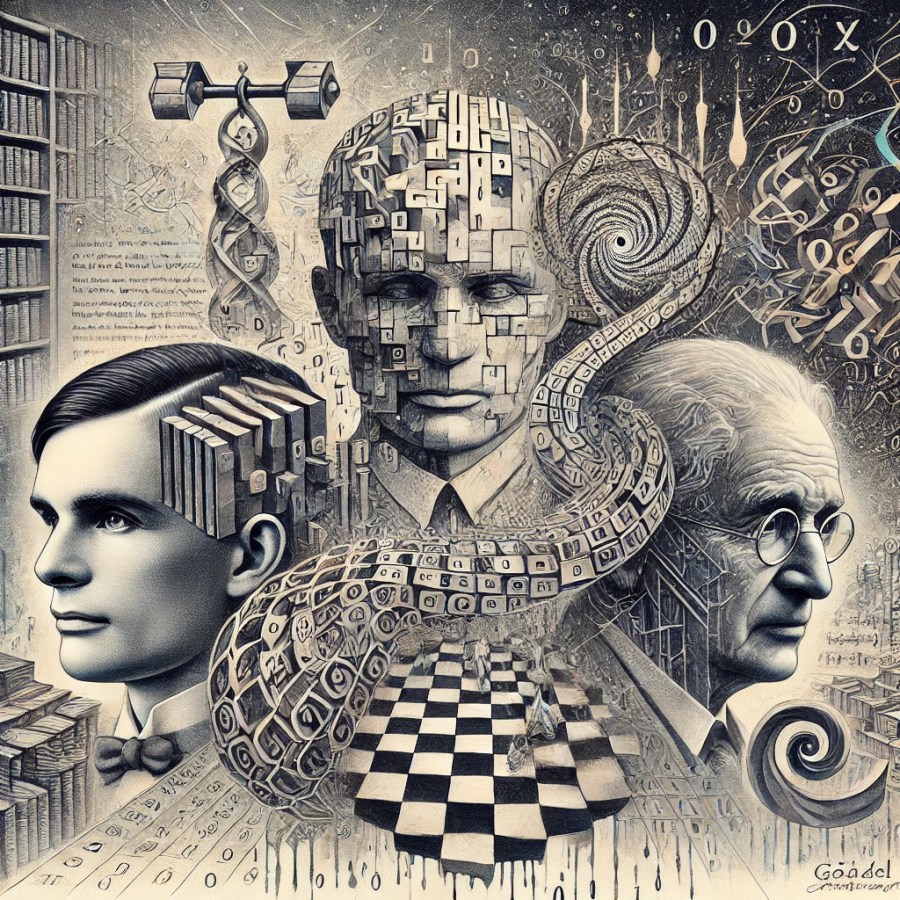

Beginnen wir mit einem Mann, der so tief in der Unvollkommenheit graben konnte, dass er selbst daran zugrunde ging: Kurt Gödel. Sein Unvollständigkeitssatz von 1931 – ein Monument der Mathematik – besagt nichts weniger, als dass in jedem konsistenten System Fragen existieren, die nicht beantwortet werden können. Wie ein unerreichbarer Horizont bleibt immer etwas, das sich der Logik entzieht. Gödel – besessen von dieser Unschärfe – vermutete, dass selbst unsere menschliche Intuition Grenzen überschreiten könnte, die Maschinen niemals erreichen werden. Doch vielleicht liegt hier ein Missverständnis. Es ist nicht die Frage, was Maschinen nicht können, sondern was sie durch ihre Begrenzungen sichtbar machen.

Alan Turing, dessen Name meist im selben Atemzug mit KI genannt wird, hatte eine andere Vorstellung: Er wollte Maschinen bauen, die lernen. Kein abgeschlossenes System, sondern ein ständiger Prozess. Seine Turing-Maschine – eine theoretische Konstruktion – schuf die Grundlage für alles, was wir heute KI nennen. Turing wusste jedoch: Maschinen werden niemals wahrhaft verstehen. Sie handeln, so könnte man sagen, wie Schauspieler auf der Bühne der Daten – perfekte Illusionen, ohne ein Inneres.

Und dann ist da Ludwig Wittgenstein. Er, der Sprache als Spiel verstand, erkannte in ihrer Struktur nicht nur die Möglichkeiten, sondern auch die Abgründe. „Wovon man nicht sprechen kann, darüber muss man schweigen,“ schrieb er im „Tractatus“. Vielleicht gilt dies auch für KI. Denn die Großen Sprachmodelle – GPT und ihre Verwandten – sind Meister des Schweigens. Sie hüllen das Unsagbare in ein Netz aus Wahrscheinlichkeiten und erzeugen so eine perfekte Simulation von Bedeutung, die nie wirklich zu ihrem Kern vordringt.

Die KI als Philosophin wider Willen

Hier wird es interessant: Könnte es sein, dass die wahre Funktion der KI nicht darin liegt, Antworten zu geben, sondern Fragen zu stellen? Frank H. Witt bemerkte in einem seiner Gespräche, dass KI-Systeme die Struktur des Fragens verändern. Sie zeigen uns, wo unsere Kategorien nicht ausreichen, wo unsere Denkmodelle scheitern. Sie sind nicht die Perfektion der menschlichen Rationalität, sondern ihr radikaler Spiegel.

Ein Beispiel: Ein KI-System, das versucht, moralische Entscheidungen zu treffen, gerät unweigerlich in Konflikt mit der Kontingenz des menschlichen Lebens. Was bedeutet es, „die beste Entscheidung“ zu treffen? In einer Welt, die ökonomische Effizienz fordert, wird die KI eine Antwort liefern. Doch was, wenn die Antwort den Menschen nicht zufriedenstellt? Hier zeigt sich die Unvollständigkeit: Die Maschine handelt – doch ihre Entscheidungen sind leer, weil sie den Kontext nicht spüren kann.

Die Eleganz des Scheiterns

Lassen Sie uns einen Moment innehalten. Scheitern klingt nach etwas Negativem. Doch in der Kunst, in der Philosophie, ja sogar in der Naturwissenschaft, ist das Scheitern oft der Beginn von Innovation. Ein Maler, der absichtlich Fehler macht, erzeugt oft Werke von größerer Tiefe als einer, der nur Perfektion anstrebt. KI könnte genau hier ansetzen. Nicht als vollkommene Rechenmaschine, sondern als Instrument, das uns zwingt, unsere Annahmen zu hinterfragen.

Ludwig Wittgenstein würde dies vielleicht ein „Sprachspiel“ nennen: ein Spiel, das uns zeigt, wie unser Denken funktioniert, indem es uns an seine Grenzen bringt. Die KI als Werkzeug der Irritation – nicht der Wahrheit. Eine „Brille“, wie Gödel es ausdrückte, die uns nicht schärfer sehen lässt, sondern die Unschärfe bewusst macht.

Ein Blick in die Zukunft

Was bedeutet das für unsere Gesellschaft? Wenn wir KI als unvollendetes System begreifen, öffnen sich neue Möglichkeiten. Anstatt Maschinen zu bauen, die uns ersetzen, könnten wir Systeme schaffen, die unsere Schwächen ausgleichen, die unsere Unvollkommenheit als Ressource nutzen.

Stellt Euch vor, eine KI, die in der Medizin arbeitet, würde nicht versuchen, den Arzt zu kompensieren, sondern dessen blinde Flecken zu finden. Oder ein Bildungssystem, in dem KI nicht das Lernen standardisiert, sondern den individuellen Zugang zu Wissen revolutioniert. In einer Welt, die von Perfektion besessen ist, könnte die Akzeptanz von Unvollkommenheit unser größter Fortschritt sein.

Schlussfolgerung: Eine Einladung zur Unvollendung

Am Ende bleibt die Frage: Was wollen wir wirklich von der KI? Soll sie unsere Fehler korrigieren, unsere Schwächen ausmerzen? Oder kann sie uns helfen, mit dem zu leben, was wir nicht wissen, nicht verstehen? Witt, Turing, Gödel und Wittgenstein – sie alle würden vielleicht sagen: Die Antwort ist nicht das Ziel. Die Frage ist es.

Die wahre Intelligenz, könnte man sagen, liegt in der Eleganz der Unvollendung.

Pingback: Emergenz, KI und Leadership: Von Konzepten zur Anwendung - Über den Nutzen der strukturellen Verwirrung - ichsagmal.com

Alpha Zero spielte einest eine Reihe von Partien gegen das stärkste Schachprogramm auf dem Markt.

Eine Partie aus dem Treffen wird gerne zitiert: Alphazero opfert Material „auf lange Sicht“. Es versteht, daß es das machen kann, daß im Dickicht der nächsten 10 , 15 Zugpaare keine Widerlegung zu finden sein wird. Nun hat Alphazero dieses Dickicht wohl nicht durchforstet, sondern hatte Kriterien an der Hand, nennen wir es „Erfahrung“ aus zig Trainingspartien, daß die Entscheidung korrekt ist.

Denkbar wäre auch, daß eine 98%ige Sicherheit für Alphazero genügte, es anzugehen.

Wie auch immer, war der Entscheidungsprozess ein anderer wie die von Menschen.

Womit wir bei der „Ungenauigkeit“ angekommen sind. Alphazero konnte eine Entscheidung treffen. Es beherrschte den Wust und das Dickicht soweit, eine verantwortliche Entscheidung zu treffen. Da es ein Schachspiel war, hat das hier natürlich ein anderes Gewicht wie bei anderen, bedeuteren Fragen. Aber auch da wird Alphazero oder eine andere Maschine nicht 100 % erreichen können – meine ich.

Ihr versteht aber, dass das, was die PR-Abteilungen in den letzten Jahren erfolgreich als „KI“ etabliert haben, keine künstliche Intelligenz ist? Dass ein LLM weder Intelligenz noch Verstehen, Bewusstsein oder ähnliches enthält oder entwickeln kann, egal wieviele GPUs man darauf wirft?

Wenn man das alles nämlich verstanden hat, fragt man sich, über welche „KI“ ihr hier genau schreibt. Es klingt nach der KI, die man aus Sci-Fi-Filmen und -Büchern kennt. Die macht in diesem Zusammenhang Sinn. Aber dort sind wir noch lange nicht und werden es vielleicht auch nie sein.