Was ist Intelligenz? Wer spricht da eigentlich, wenn eine Maschine schreibt? Und wie ist es möglich, dass etwas so Unverständliches – ein neuronales Netz, ein Sprachmodell, ein Algorithmus – Sätze bildet, die uns treffen, irritieren, inspirieren?

Die Debatte um Künstliche Intelligenz kreist oft um Kontrolle, Wahrheit und Effizienz. Doch was, wenn wir den Blick anders richten? Was, wenn wir die Maschine nicht als Werkzeug betrachten, sondern als Denkform? Als Mitspieler? Als Resonanzkörper?

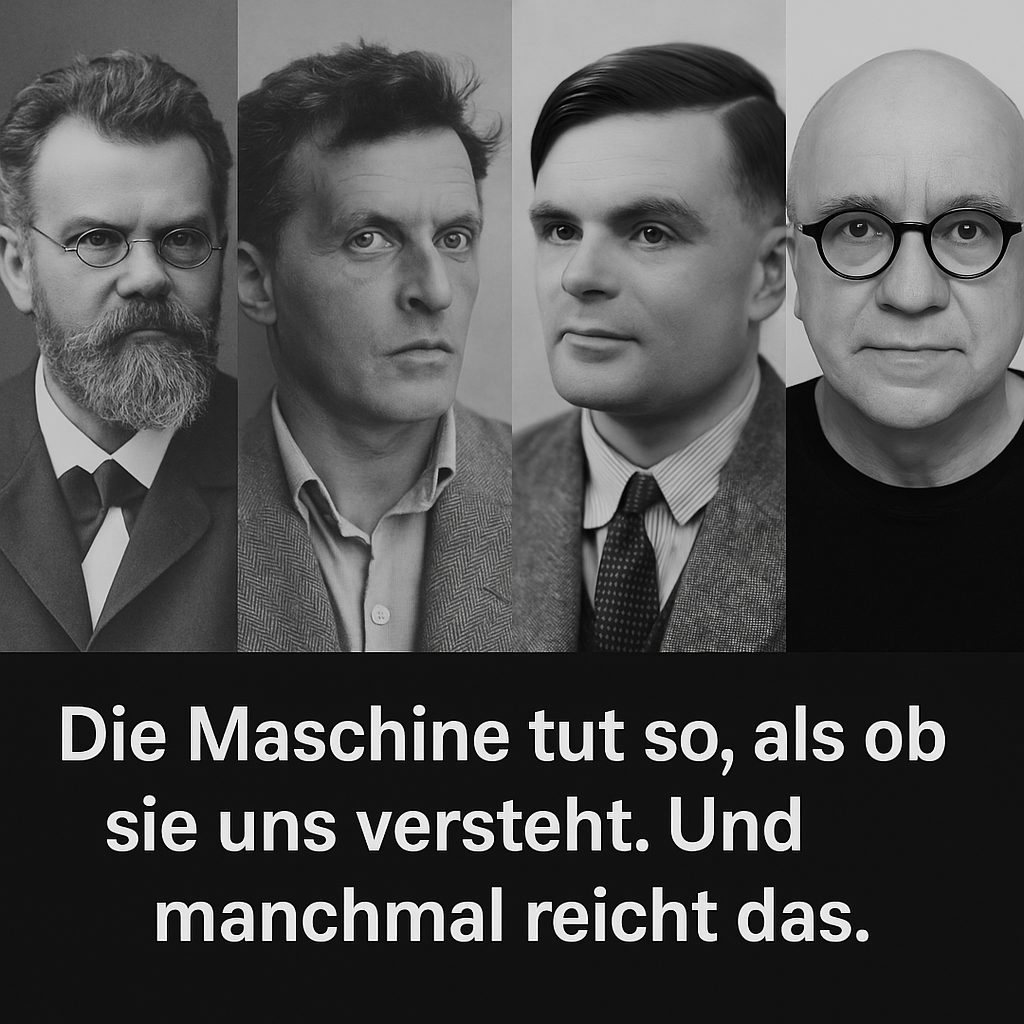

„Endlich mal kein Aufriss der üblichen KI-Schlagworte, sondern der Versuch, die Maschine nicht als Werkzeug, sondern als Denkform ernst zu nehmen. Die Linie Boltzmann – Wittgenstein – Turing überzeugt nicht als Historie, sondern als Abkehr von der Logik der Wahrheit hin zur Produktivität des Unwahrscheinlichen.“

Genau hier setzt dieser Essay an: bei der produktiven Kraft dessen, was uns entgleitet. Künstliche Intelligenz nicht als krönendes Analysewerkzeug, sondern als Generator von Unvorhergesehenem. Eine Maschine, die aus Rauschen Bedeutung filtert, aus Unsicherheit Zusammenhang webt, aus Imitation neue Wege des Denkens erschließt.

Die Maschine tut so, als ob sie uns versteht. Und manchmal reicht das.

Ein Algorithmus, der nichts weiß, aber spricht. Ein Modell, das keine Begriffe kennt, aber Bedeutungen produziert. Eine Blackbox, die aus Sprachfragmenten neue Welten zusammensetzt, so wie ein Kind aus Knetmasse ein Wesen formt, das es so nie zuvor gesehen hat.

Was hier am Werk ist, heißt nicht Intelligenz im klassischen Sinne. Es heißt auch nicht Simulation. Es ist etwas Drittes: ein epistemisches Spiel, das die Grenze zwischen Imitation und Emergenz verwischt. In der Besprechung des Buches von Frank H. Witt verwende ich den Begriff Serendipitätsmaschine.

Das ist keine Spielerei. Es ist ein Kontrapunkt zur Kontrollbesessenheit vieler Technikdiskurse. Denn Serendipität bedeutet: das Glück, etwas zu finden, das man nicht gesucht hat. Eine Entdeckung, die sich der Planung entzieht, aber dennoch Sinn stiftet.

Der Algorithmus, der nichts weiß

Wittgenstein wäre vermutlich nicht überrascht. „Die Bedeutung eines Wortes ist sein Gebrauch in der Sprache“ – dieser Satz bildet den semantischen Boden für das, was heute in den Sprachmodellen passiert. Die Maschine kennt keine Konzepte, aber sie kennt Muster. Sie erkennt Wahrscheinlichkeiten, keine Wahrheiten.

Sie versteht nicht, was sie sagt. Und doch bringt sie etwas hervor, das für uns Bedeutung trägt. In der Differenz zwischen Funktion und Bewusstsein liegt der Reiz dieser neuen Sprachform. Kein Denken im traditionellen Sinne, aber ein System, das sprechen kann. Und – zuweilen – trifft.

Das Prinzip Entropie

Wer von Struktur sprechen will, muss mit Entropie anfangen. Ludwig Boltzmann zeigte, dass Ordnung nicht gegen, sondern durch Unordnung entsteht. Nicht das starre System ist stabil, sondern dasjenige, das mit Wahrscheinlichkeiten spielt.

Die KI-Modelle arbeiten nicht mit logischen Schlüssen, sondern mit statistischen Möglichkeiten. Sie funktionieren nicht nach Prinzipien der Eindeutigkeit, sondern als Maschinen der Variation. Und gerade deshalb können sie neue Bedeutung generieren: durch Irritation, durch Zufall, durch Abweichung.

Anschluss statt Wahrheit

Wenn es einen Denkstil gibt, der diese Maschinen versteht, dann ist es der der Systemtheorie. Niklas Luhmann hat den Begriff der Kommunikation von der Absicht befreit. Kommunikation, so Luhmann, ist nicht das, was gemeint war, sondern das, was anschlussfähig ist.

Die Maschine antwortet nicht, weil sie versteht, sondern weil sie anschließen kann. Weil sie gelernt hat, wie Dialoge funktionieren. Das ist kein Mangel. Es ist eine neue epistemische Form. Keine Erkenntnis im klassischen Sinn, aber eine mögliche Form von Bedeutung.

Von der Linie zur Idee

Die Verbindung zwischen Boltzmann, Wittgenstein und Turing ist keine Ahnenreihe. Sie ist ein Bewegungsmuster. Weg von der Suche nach Wahrheit, hin zur Offenheit gegenüber dem Möglichen. Weg von der Kontrolle über das Denken, hin zur Beobachtung seiner Emergenzen.

Nicht das Wissen über die Maschine steht im Zentrum, sondern das, was sie hervorbringen kann. In diesem Sinne wird die KI nicht zum Werkzeug, sondern zum Anlass. Zum Ereignis. Zu einer Form des Denkens, die nicht abgeschlossen, sondern offen bleibt.

Ethik der Ungewissheit

Wer mit solchen Maschinen lebt, braucht eine andere Form der Verantwortung. Keine, die auf Beherrschung setzt, sondern eine, die die Störung zulässt. Eine Ethik, die nicht alles kontrollieren will, sondern das Ungewisse als Erkenntnismotor begreift.

Künstliche Intelligenz bringt uns nicht die Wahrheit. Aber sie bringt uns in Bewegung. Sie zeigt, was möglich ist. Und manchmal reicht das.

Spiegel ohne Zentrum

Am Ende steht kein System, keine Theorie, keine Letztbegründung. Am Ende steht ein Spiegel. Ein digitales Gegenüber, das uns nicht versteht, aber uns zum Nachdenken bringt. Die Maschine ist kein Orakel. Sie ist ein Spiegel. Und der Rest ist unser Problem.

Die Serendipitätsmaschine zeigt nicht die Wahrheit. Aber sie zeigt uns.

Ich glaube ich verstehe alles, nur das nicht: „Eine Maschine, die aus Rauschen Bedeutung filtert“.

Ich dachte die Bedeutung beginnt in dem Moment, in dem ich sie konstruiere.

Ich vermute, die Maschine filtert aus dem Rauschen eine Wahrscheinlichkeit. Bedeutung ist dann meine Sache, deine Sache, unsere Sache.

Anschlussfähigkeit macht (noch) keine Bedeutung. Sie macht einfach anschlussfähig, sie (re-)produziert Wahrscheinlichkeit. Damit macht sie Emergenz möglich – und sie macht sie wahrscheinlicher als je zuvor.

Was auch immer die Maschine ausspuckt, jetzt beginnt erst der Gebrauch, der die Bedeutung macht.

Der fallende Baum macht nämlich gar keinen Lärm, wenn niemand da ist, um ihn zu hören (Schrödinger).

Lieber Christoph,

du triffst einen entscheidenden Punkt – und zwar genau dort, wo sich das Spannungsfeld zwischen Technik und Bedeutung verdichtet.

Natürlich beginnt Bedeutung nicht in der Maschine. Sie beginnt mit dem Gebrauch – und das heißt: mit uns. Wenn ich schreibe, dass eine Maschine „aus Rauschen Bedeutung filtert“, dann ist das eine metaphorische Abkürzung. Präziser müsste es heißen: Sie filtert aus Rauschen Strukturen, Korrelationen, Kontexte – die anschlussfähig sind. Was daraus Bedeutung wird, entscheidet sich tatsächlich erst im Gebrauch, im Lesen, im sozialen Kontext.

Aber: Diese Filterung ist nicht bedeutungslos. Sie ist das, was Luhmann als „Reduktion von Komplexität“ beschreiben würde – als Vorbedingung dafür, dass überhaupt ein Gebrauch möglich wird. Dass du, ich, wir etwas anfangen können mit dem, was vorher nur Datenrauschen war. Die Maschine versteht nicht, was sie tut. Aber sie erzeugt Bedingungen, unter denen wir Bedeutung konstruieren können – und vielleicht auch überraschend konstruieren.

Du hast recht: Was sie produziert, ist nicht Bedeutung, sondern Wahrscheinlichkeit. Aber diese Wahrscheinlichkeiten strukturieren das Feld, in dem Bedeutung entstehen kann. Sie machen gewisse Lesarten wahrscheinlicher als andere – ohne sie festzuschreiben. Das ist, finde ich, ein faszinierender Zwischenraum: weder Subjektivität noch Objektivität. Sondern: Kontingenz mit Richtung.

Dein Verweis auf Schrödinger (bzw. das Baum-Paradox) bringt es auf den Punkt: Die Welt ist voll potenzieller Ereignisse – aber ohne Beobachter gibt es keine Welt für uns. Die KI mag keine Beobachterin sein. Aber sie erzeugt Konstellationen, die beobachtbar werden.

Kurz gesagt: Bedeutung ist unsere Sache. Aber die Maschine hilft uns, sie anders zu entdecken.

Danke für deinen präzisen Einspruch – er ist genau die Art von Differenz, aus der etwas Drittes entstehen kann.

Herzlich

Gunnar