Die Vermessung des Denkens

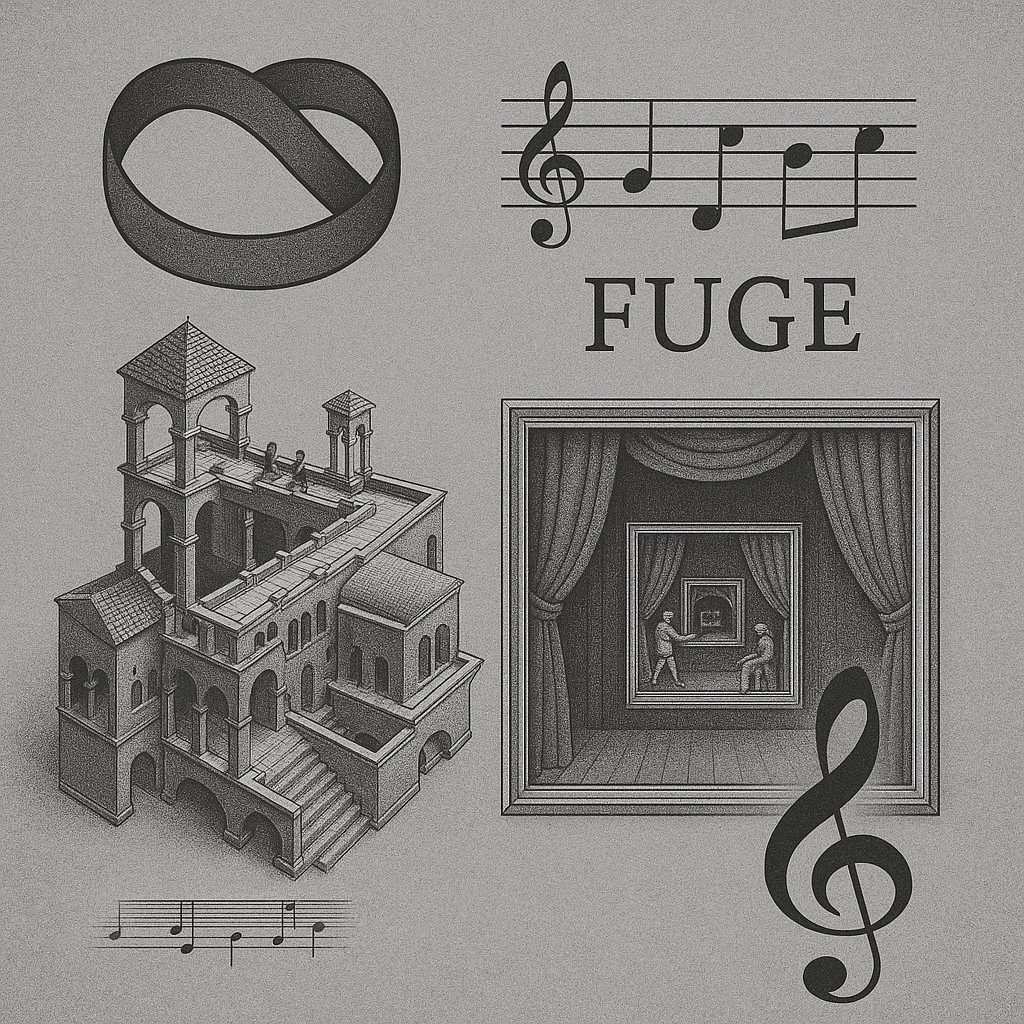

Was haben eine barocke Fuge von Bach, eine unmögliche Treppe von Escher und ein mathematischer Satz von Kurt Gödel gemeinsam? Mehr, als man auf den ersten Blick vermuten würde. In den Räumen dazwischen entfaltet sich ein faszinierender Gedankengang: Wie lassen sich Systeme beschreiben, die sich selbst zum Gegenstand machen? Und was bedeutet das für Künstliche Intelligenz?

Zwei Autoren, die auf je eigene Weise darauf antworten, sind Douglas R. Hofstadter mit seinem Werk „Gödel, Escher, Bach“ und Frank H. Witt mit seiner Theorie einer kontextsensiblen, kontingenzoffenen KI. Beide suchen nach einem Verständnis der Welt, das die Grenzen formaler Systeme nicht übergeht, sondern produktiv nutzt. Diesem Denkweg wollen wir hier folgen – präzise, verständlich und mit mathematischem Tiefgang.

Gödels Unvollständigkeitssatz: Ordnung mit einem Loch

Kurt Gödel bewies 1931 einen Satz, der in seiner Tragweite kaum zu überbieten ist. Vereinfacht gesagt: Jedes hinreichend mächtige formale System (etwa die Arithmetik) enthält Aussagen, die wahr sind, aber innerhalb des Systems nicht bewiesen werden können.

Formal heißt das: Wenn ein System konsistent ist (also keine Widersprüche enthält), dann ist es unvollständig. Es gibt eine Aussage G, für die gilt:

Wenn G im System beweisbar wäre, wäre das System widersprüchlich.

Also ist G nicht beweisbar, aber außerhalb des Systems als wahr erkennbar.

Der Clou: G ist eine Aussage, die sinngemäß sagt: „Ich bin nicht beweisbar.“ Das System stolpert über seine eigene Reflexion. Gödel gelang dies mit einem genialen Kodierungstrick – der sogenannten Gödelnummerierung, mit der Aussagen in Zahlen übersetzt werden können.

Warum das wichtig ist: Maschinen, die formale Systeme verwenden, um zu „denken“, werden immer an Aussagen stoßen, die sie nicht entscheiden können. Künstliche Intelligenz hat also strukturelle Blindstellen.

Hofstadters Schleifen: Das Ich als rekursives Muster

Douglas Hofstadter führt Gödels Idee weiter. Für ihn ist Bewusstsein eine Art „Strange Loop“ – eine Rückverweisung innerhalb eines Systems, die eine Illusion von Einheit erzeugt. Wenn ein Gehirn über sich selbst nachdenkt, entsteht so etwas wie ein „Ich“. Kein statisches Zentrum, sondern ein dynamisches Muster.

In Musik (Bachs Kanons), in Kunst (Eschers unendliche Treppen) und in Logik (Gödels Sätze) erkennt Hofstadter dieselbe Struktur: rekursive Selbstbeobachtung. Daraus entsteht Bedeutung. Doch wie lässt sich das greifbar machen?

Ein anschauliches Beispiel: Stellen wir uns ein Theaterstück vor, in dem die Schauspieler irgendwann merken, dass sie Figuren in einem Stück sind – und beginnen, das Stück selbst umzuschreiben. Die Handlung reflektiert sich selbst. Es entsteht ein Spiel im Spiel. Diese Art von Schleifenstruktur erzeugt eine neue Ebene der Bedeutung. In der Sprache nennt man so etwas Metareflexion; im Denken: Selbstbewusstsein.

In Gödels Version ist diese Schleife formal: Eine Aussage spricht über ihre eigene Beweisbarkeit. Bei Hofstadter wird daraus ein Modell für das menschliche Ich – als eine stabile Illusion, erzeugt durch Selbstbeobachtung in rekursiven Strukturen.

Witt: Wahrscheinlichkeiten statt Wahrheit

Frank H. Witt geht noch einen Schritt weiter. Für ihn ist die Welt kein festes System, sondern eine Zone der Wahrscheinlichkeiten. Seine KI-Theorie stützt sich auf stochastische Prozesse – etwa ähnlich wie in der statistischen Mechanik bei Boltzmann. Dort erklärt man Ordnung (z. B. Gasdruck) durch Mittelwerte von zufälligen Mikrobewegungen.

Witt überträgt das auf Sprache und Bedeutung. KI, so argumentiert er, kann nicht durch festgelegte Regeln funktionieren, sondern nur durch Wahrscheinlichkeitsverteilungen:

P(Bedeutung | Kontext) = höchste Wahrscheinlichkeit, dass eine Wortbedeutung passt

Ein Sprachmodell wie GPT funktioniert ähnlich: Es berechnet Wahrscheinlichkeiten, welches Wort oder welcher Satz als nächstes am plausibelsten ist. Kein Wissen im klassischen Sinn, sondern Mustervervollständigung im Kontext.

Zufall, Kontingenz, Serendipität

Witt verwendet den Begriff der Serendipität nicht explizit. Doch seine Argumentation ist offen für genau diese Deutung: Wissen entsteht nicht durch lineare Planung, sondern durch Überraschung im System. Das erinnert an wissenschaftliche Entdeckungen, die durch Umwege, Fehler oder Störungen entstehen.

Mathematisch betrachtet bedeutet das: Systeme mit Rauschen (Störung) können resilienter und kreativer sein als perfekt geregelte Maschinen. Das ist die Umwertung des Zufalls: Nicht als Störung, sondern als Ermöglichungsbedingung von Erkenntnis.

Warum das alles für KI und Gesellschaft zählt

Gödel zeigt: Es gibt immer etwas, das wir im System nicht wissen können. Hofstadter zeigt: Bewusstsein ist kein Ding, sondern ein Muster von Schleifen. Witt zeigt: Intelligenz lebt von Wahrscheinlichkeiten, Kontexten und offenen Möglichkeitsräumen.

Eine KI der Zukunft wird keine Maschine der Gewissheit sein, sondern ein Verstärker für Serendipität. Sie wird nicht alles wissen, aber sie wird helfen, neue Wege zu finden. Und vielleicht wird gerade darin ihre Größe liegen: in der Kunst, nicht alles entscheiden zu wollen, sondern das Mögliche offen zu halten.

Nachsatz

Wer über KI spricht, muss auch über die Bedingungen des Denkens sprechen. Und über seine Grenzen. Vielleicht ist der wichtigste Beitrag von Gödel, Hofstadter und Witt, dass sie uns lehren, mit Grenzen zu leben – und sie in produktive Schleifen zu verwandeln.

Wie Rudolf Augstein es stets formulierte, wenn er etwas richtig gut und lesenswert fand: Chapeau!

Das ersetzt — zumindest vorläufig — ein Kapitel, von dem ich dachte, es interessiere zu wenige Leser und fiel deshalb Kürzungen zum Opfer. Einige Notizen dazu:

Mathematik im Umbruch (1900–1936):

Um 1900 glaubte man, die gesamte Mathematik ließe sich formal und widerspruchsfrei begründen (Hilberts Programm, 1920). Dann kamen drei Schocks:

Gödel (1931): Es gibt immer unbeweisbare Wahrheiten.

Turing (1936): Es gibt unentscheidbare Probleme — keine Maschine kann sie lösen.

Quantenphysik (Heisenberg, Bohr): Keine totale Determiniertheit auch in der Physik.

Wittgensteins Kritik:

Er sah die Debatte als Missverständnis über Sprache und Praxis: Mathematik sei kein „ideales Reich“, sondern ein von Menschen geschaffener Kulturraum mit Regeln. Credits to Ludwig Wittengenstein und Alan Turing, dass haben die beiden 1939 miteinander ausgefochten, Turing hat sich sogar eine Ohrfeige eingefangen!