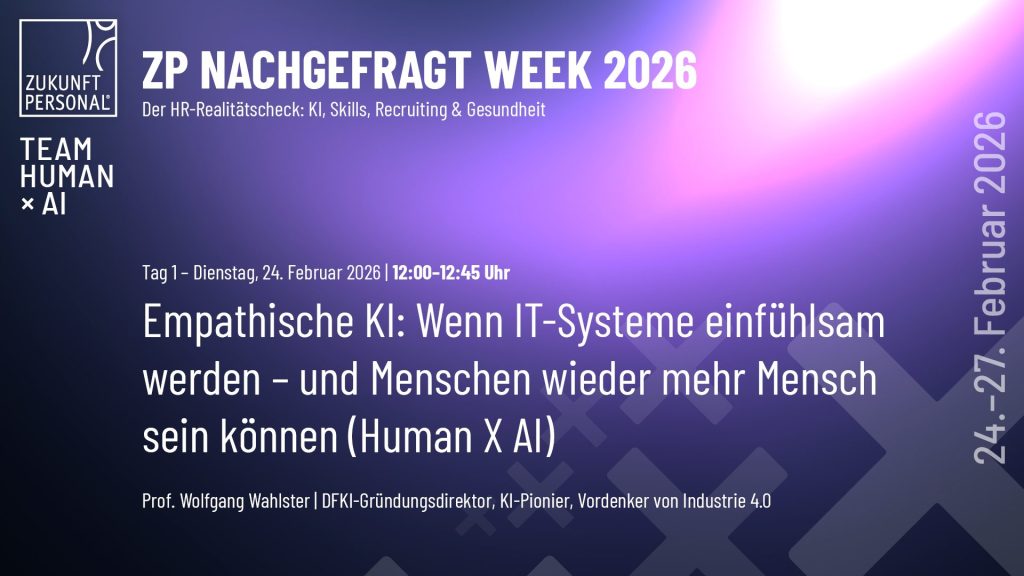

Die nächste Produktivitätswelle kommt nicht mit mehr Rechenleistung, sondern mit einem paradoxen Versprechen: Maschinen sollen einfühlsamer werden, damit Menschen weniger Maschine sein müssen. In der Session „Empathische KI: Wenn IT-Systeme einfühlsam werden – und Menschen wieder mehr Mensch sein können (Human X AI)“ beschreibt Professor Wolfgang Wahlster, Gründungsdirektor des Deutschen Forschungszentrums für Künstliche Intelligenz (DFKI), genau diesen ökonomischen Kipppunkt: Kognitive KI ist heute Commodity – der Engpass wandert zur emotionalen und sozialen Intelligenz der Systeme.

Wahlster gliedert „Intelligenz“ in vier Dimensionen: kognitiv, sensorphysisch, emotional und sozial. Kognitiv sind Systeme inzwischen beeindruckend; sensorphysisch bleibt Robotik oft unter menschlichem Niveau. Der lange Rückstand – und damit die neue Wertschöpfungschance – liegt in emotionaler und sozialer Intelligenz: Wer Stimmungen erkennt, angemessen reagiert und das auch multimodal ausdrücken kann (Sprache, Mimik, Gestik), gestaltet Interaktion neu – und damit Prozesse.

Deutschlands unterschätzter Vorsprung: Personalisierung ist kein GenAI-Trend, sondern Forschungstradition

Bemerkenswert ist Wahlsters historischer Seitenhieb: Der Kern dessen, was heute als „Human-centric AI“ verkauft wird, wurde in Deutschland vor Jahrzehnten als empathische Benutzermodellierung diskutiert – inklusive frühem Workshop (Maria Laach) und der bis heute aktiven Community rund um User Modeling, Adaptation and Personalization (UMAP). Diese Kontinuität ist wirtschaftlich relevant, weil sie ein Gegenargument zu einer verbreiteten Erzählung liefert: Europa sei bei KI zwangsläufig Nachzügler. Für empathische Interaktion gilt das so pauschal nicht.

Drei Schritte zur Empathie – und warum sie sich in Euro messen lassen

Wahlster reduziert empathische Systeme auf eine klare Prozesslogik:

Emotionen erkennen (z. B. über Stimme, Tempo, Tonhöhe).

Adaptiv reagieren (Kontext, mentaler Zustand, „was braucht mein Gegenüber gerade?“).

Multimodal ausdrücken (nicht nur Text, sondern Verhalten, Ton, Gestik).

Das klingt nach Soft-Skills. Ist aber knallharte Prozessökonomie. Im Callcenter etwa entscheidet Emotionslage über Eskalation und Bearbeitungszeit. Wahlster beschreibt, wie sich starke Emotionalisierung bereits mit wenigen, robust extrahierbaren Sprachparametern erkennen lässt – und dann gezielt an deeskalationsstarke Mitarbeitende geroutet werden kann. Ergebnis: weniger „Hotline-Terror“, höhere Erstlösungsquote, geringere Fluktuation in einer ohnehin angespannten Arbeitsmarkt-Nische.

„Losgröße 1“ – diesmal nicht für Produkte, sondern für Bildung und Karriere

Die vielleicht stärkste ökonomische Idee der Session ist eine Verschiebung des Industrie-4.0-Mottos „Losgröße 1“ in den Bildungs- und Arbeitsmarkt: Personalisierung lohnt sich dort noch mehr als bei Produkten. Wahlster argumentiert, KI könne nicht nur Fehler markieren, sondern Fehlkonzepte diagnostizieren – und damit individuelle Lernlücken zielgenau schließen, was Lehrkräfte in großen Klassen aus Zeitgründen kaum leisten können.

Daran hängt eine arbeitsmarktpolitische Pointe: Wenn tutorielle Förderung und „persuasive“ Systeme (Motivation, Dranbleiben, Ermutigung) breit verfügbar werden, kann das soziale Muster „Herkunft gleich Zukunft“ aufbrechen. Nicht als Utopie, sondern als Skalierungsfrage: KI kann die Persistenz liefern, die menschliche Betreuung in überlasteten Systemen oft nicht leisten kann.

Pflege, Psychologie, Teamrobotik: Empathie wird Infrastruktur

Wahlster erweitert den Blick auf drei Felder, die 2026 nicht nur technologisch, sondern demografisch unter Druck stehen:

Ambient Assisted Living / alternde Gesellschaft: Systeme müssen Tagesform und Grundstimmung respektieren, sonst scheitert Akzeptanz im Alltag.

Psychologische Trainings- und Beratungskontexte: Menschen sind gegenüber einer KI teils offener, weil Scham- und Statusdruck sinken – ein Effekt, der für Prävention, Training und Versorgungskapazitäten relevant wird.

Teamrobotik in der Industrie: Gemischte Teams aus Menschen und Robotern brauchen soziale Intelligenz (Rollen, Ausfälle, Koordination). Empathie ist hier kein „Gefühl“, sondern ein Mechanismus zur Stabilisierung von Zusammenarbeit.

Damit wird empathische KI zur Infrastrukturtechnologie: Sie bestimmt, ob Systeme in menschlichen Umgebungen tragen – oder nur in Demos.

Normative KI: Wettbewerb über Standards, nicht über Lautstärke

Am Ende wird Wahlster europäisch-pragmatisch: Vertrauen entsteht nicht durch Claims, sondern durch Standards, Transparenz und begründete Verweigerung. Systeme müssen in der Lage sein, unethische Anfragen nicht nur abzulehnen, sondern die Ablehnung nachvollziehbar zu begründen. Das ist weniger Philosophie als Engineering – und zugleich eine strategische Positionierung gegen Modelle, die „alles beantworten“ und Verantwortung externalisieren.

Wer empathische KI als „Nettigkeit“ missversteht, übersieht den ökonomischen Kern: In einer Arbeitswelt mit Fachkräftemangel, Alterung und wachsender Servicekomplexität entscheidet Interaktion zunehmend über Produktivität. Der nächste Wettbewerbsvorteil liegt nicht darin, dass Systeme schneller schreiben, sondern darin, dass sie besser verstehen, wann Menschen Unterstützung brauchen – und wann sie in Ruhe gelassen werden wollen. Human X AI ist dann kein Motto, sondern eine Standortfrage.